Motori di ricerca e file robots.txt per il controllo degli spider

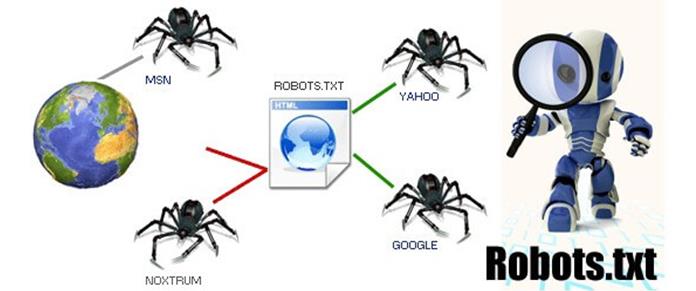

Il file robots.txt è usato per indicare agli spider dei motori di ricerca in che modo comportarsi, ovvero se analizzare o saltare un determinato file o un’intera pagina web. Tuttavia, bisogna considerare che questa è una richiesta e non è detto che lo spider la prenda in considerazione.

Le direttive che possono essere impartite agli spider attraverso il file robots.txt sono due e hanno i seguenti scopi:

- richiesta di includere o non includere i contenuti della pagina nell’archivio dei motori di ricerca;

- richiesta di seguire o non seguire tutti i link presenti nella pagina, con lo scopo di individuare le altre pagine del sito.

Per creare il file robots.txt basta usare un qualsiasi editor di testo e creare un file chiamato “robots.txt”. Il file è composto dall’istruzione “User-agent:”, che indica il nome dello spider, seguita dall’istruzione “Disallow:”, che indica allo spider cosa non deve analizzare. Ad esempio, se vogliamo che una pagina web non sia analizzata esclusivamente dallo spider di Google, scriveremo “User-agent: googleboot”; così facendo si può evitare il passaggio esclusivamente allo spider di Google per le pagine e i contenuti indicati. Viceversa, se si vuole evitare il passaggio a tutti gli spider di qualsiasi motore di ricerca, è sufficiente scrivere “User-agent:*”.

Vediamo alcuni esempi:

- In questo caso viene indicato esclusivamente allo spider di Google di saltare la cartella delle immagini.

User-agent: Googleboot

Disallow: /images/ - In questo caso viene indicato a tutti gli spider di saltare la cartella delle immagini.

User-agent: *

Disallow: /images/ - Quest’ultimo esempio indica che nessun motore di ricerca deve visitare il sito.

User-agent: *

Disallow: /