Differenza tra codice binario e ASCII in informatica

Il codice binario è un metodo utilizzato nei computer e nei dispositivi digitali per rappresentare e trasferire testo, simboli o istruzioni del processore. Poiché i computer e i dispositivi digitali eseguono le loro operazioni fondamentali in base a due valori di tensione (Alto o Basso), ogni bit di dati coinvolti in un processo deve essere convertito in quella forma. Il metodo ideale per eseguire questa operazione è rappresentare i dati nel sistema numerico binario, che include solo due cifre, 1 e 0. Ad esempio, ad ogni pressione di un tasto sulla tastiera, produce una stringa di 1 e 0, che è unico per ogni personaggio e lo invia come output. Il processo di conversione dei dati in codice binario è chiamato codifica. Molti metodi di codifica vengono utilizzati nell’informatica e nelle telecomunicazioni.

D’altro canto, ASCII acronimo di American Standard Code for Information Interchange, è una codifica standard per i caratteri alfanumerici utilizzati nei computer e nei dispositivi correlati. ASCII è stato introdotto dallo United States of America Standards Institute (USASI) ora noto come American National Standards Institute.

Codice binario

Il modo più semplice per codificare un dato è assegnare un valore specifico (principalmente in numeri decimali) al carattere o al simbolo o all’istruzione, quindi convertire il valore (numero decimale) nel numero binario, che consiste solo di 1 e 0. La sequenza di 1 e 0 è chiamata come stringa binaria. La lunghezza della stringa binaria determina il numero di diversi caratteri o istruzioni che possono essere codificati. Con una sola cifra, possono essere rappresentati solo due caratteri o istruzioni differenti. Con due cifre, è possibile rappresentare quattro caratteri o istruzioni. In genere, con una stringa binaria di n cifre, è possibile rappresentare 2 n caratteri, istruzioni o stati diversi.

Esistono molti metodi di codifica con diverse lunghezze di stringhe binarie, di cui alcuni hanno lunghezza costante e gli altri lunghezza variabile. Alcuni dei codici binari con stringhe di bit costanti sono ASCII, ASCII esteso, UTF-2 e UTF-32. UTF-16 e UTF-8 sono codici binari di lunghezza variabile. Sia la codifica Huffman che il codice Morse possono anche essere considerati codici binari di lunghezza variabile.

Codice ASCII

ASCII è uno schema di codifica dei caratteri alfanumerici introdotto negli anni ’60. ASCII originale utilizza una stringa binaria lunga 7 cifre, che gli consente di rappresentare 128 caratteri. Una versione successiva di codice ASCII chiamato ASCII esteso utilizza 8 cifre lunga stringa binaria dandogli la capacità di rappresentare 256 caratteri diversi.

Il codice ASCII include, principalmente, due tipi di caratteri, che sono caratteri di controllo (rappresentati da 0-31 decimale e 127 decimale) e caratteri stampabili (rappresentati da 32-126 decimale). Ad esempio, alla cancellazione della chiave di controllo viene assegnato il valore 127 decimale rappresentato da 1111111. Il carattere a, a cui viene assegnato il valore 97 decimale, è rappresentato da 1100001. Infine, l’ASCII può rappresentare lettere in entrambi i casi, numeri, simboli e chiavi di controllo.

Differenza tra Codice binario e ASCII

Per concludere possiamo concludere dicendo che, il codice binario è un termine generico usato per un metodo di codifica di caratteri o istruzioni, invece l’ASCII è solo una delle convenzioni di codifica di caratteri globalmente accettate ed è stato lo schema di codifica binaria più comunemente usato per più di tre decenni.

Inoltre, il codice binario può avere lunghezze diverse per la codifica a seconda del numero di caratteri, istruzioni o metodo di codifica, mentre il codice ASCII utilizza solo una stringa binaria di 7 cifre e 8 cifre per ASCII esteso.

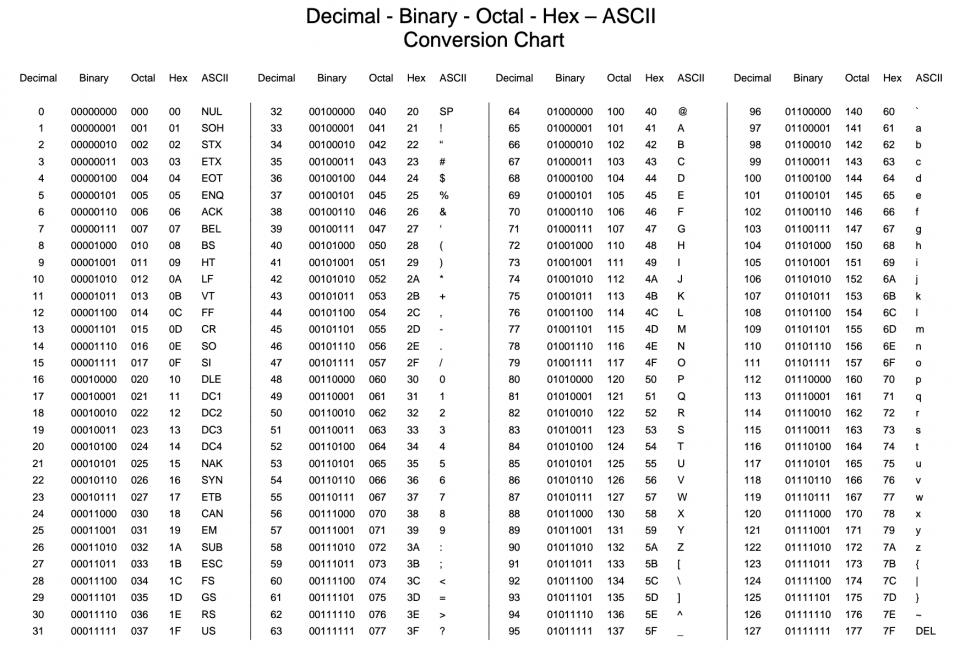

Infine, qui di seguito la tabella del codice binario e ASCII.